はじめに

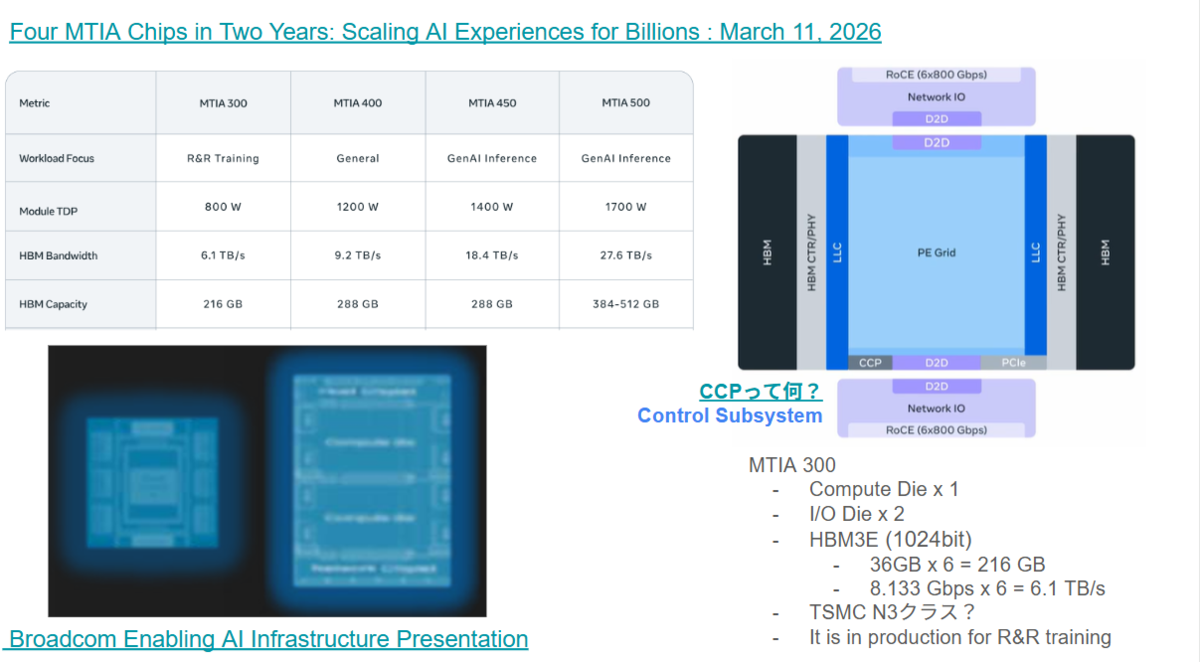

Meta が MTIA 300, 400, 450, 500 を発表しました。

過去の資料との比較

Broadcom Enabling AI Infrastructure Investor Meetingの以下の資料 (2024年3月24日) の Meta と思われるスライドにあるものと比較します。

MTIA 300

ほぼ当たり

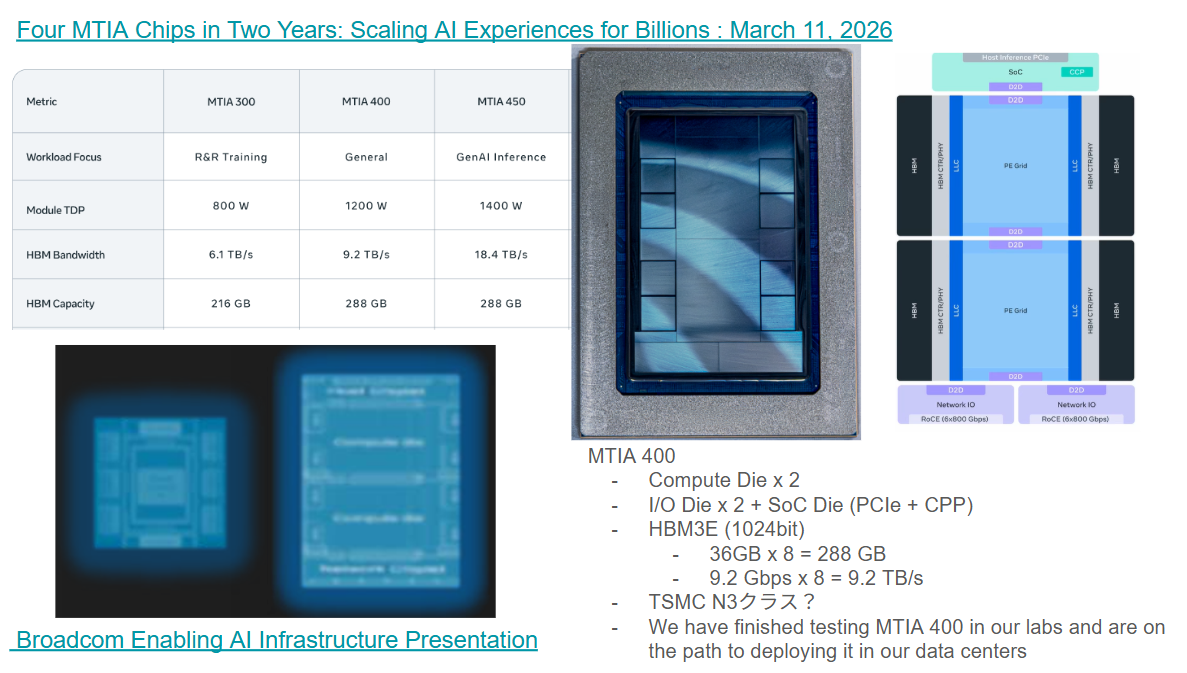

MTIA 400

ほぼ当たり

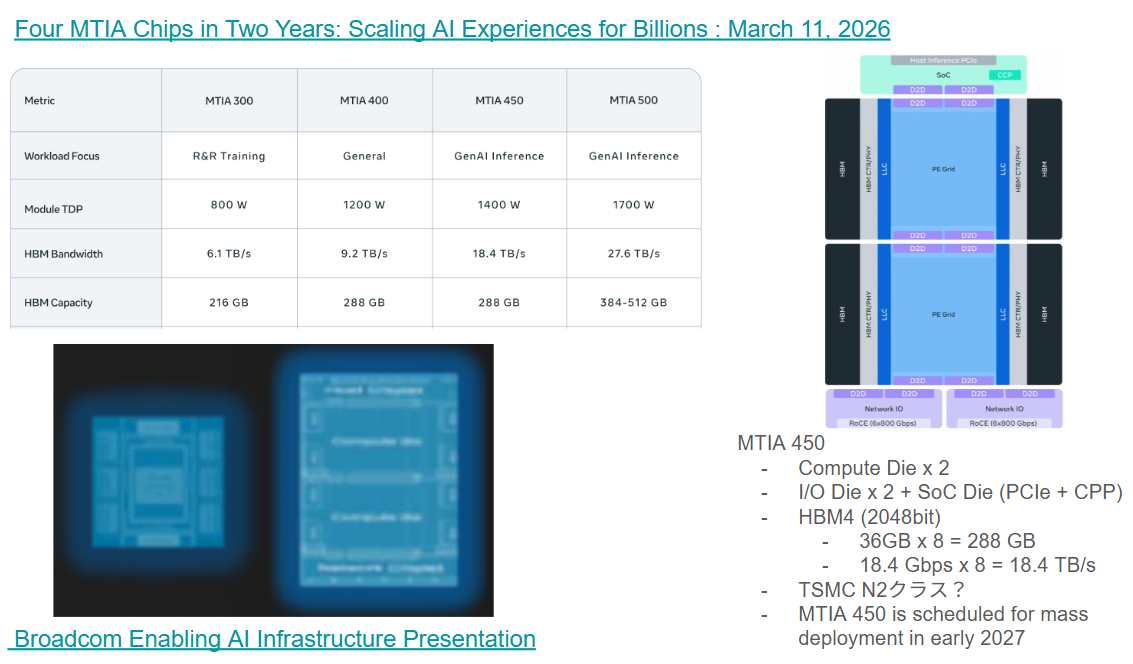

MTIA 450

MTIA 400 の改善版っぽい

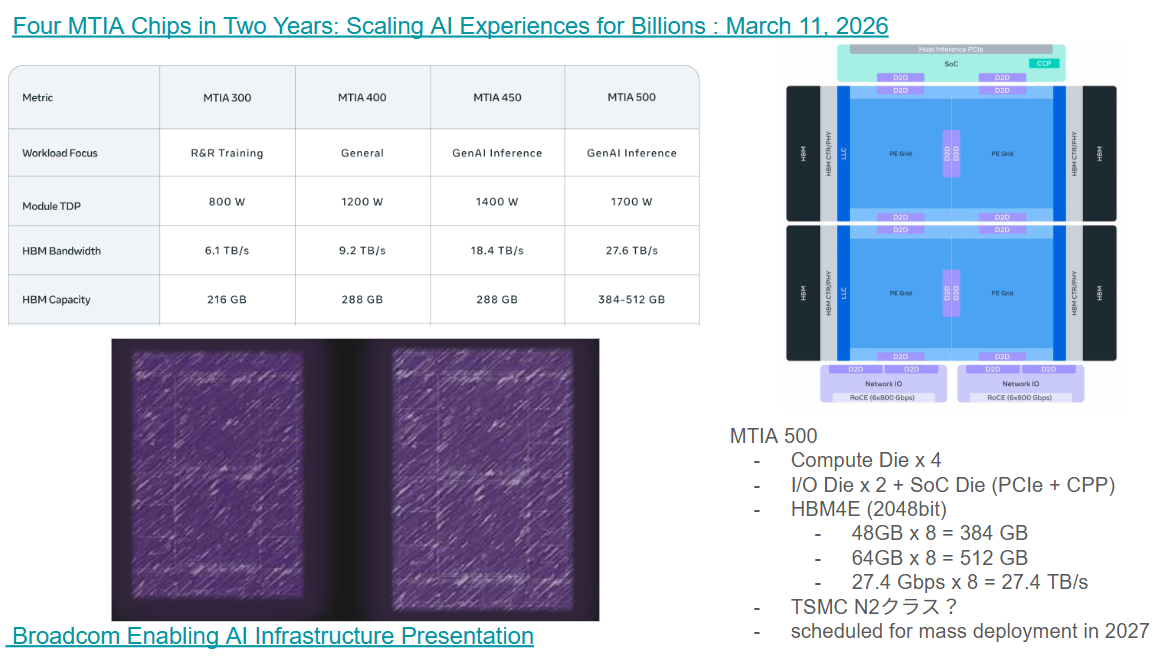

MTIA 500

HBMが8個 or 12個?

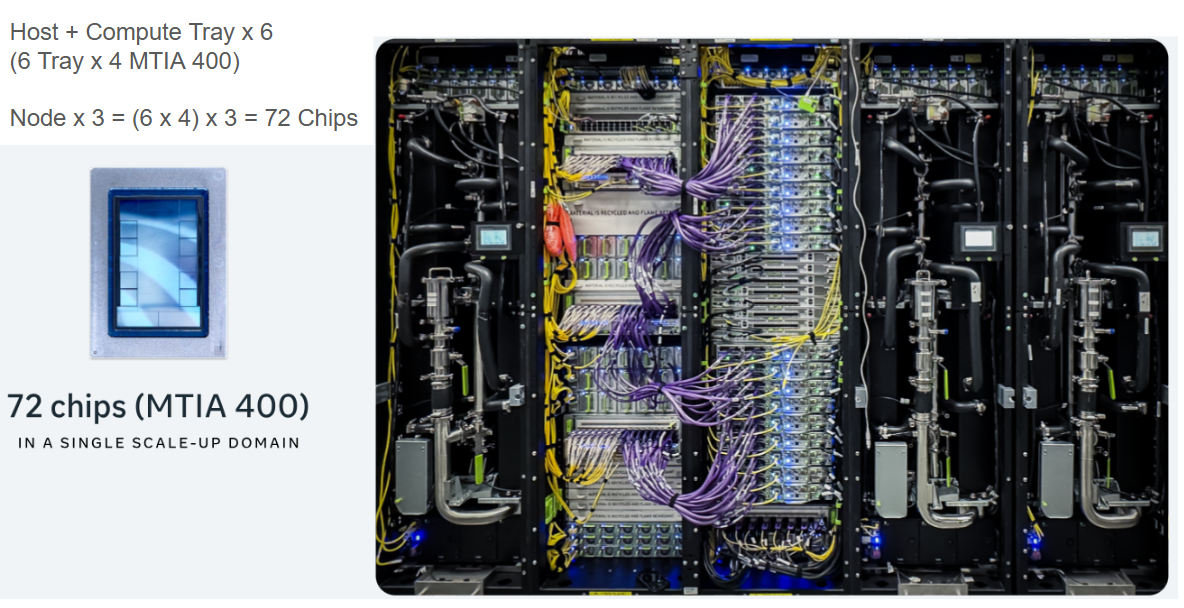

MTIA 400 からは、1 Rack 72 Package

MTIA 400, 450, 500 は、72 Package 構成

Bloomberg の Youtube Short から

下記の動画にもMTIA 300/400関連が出てきましたので、記録に残します。(画像を説明のために引用します)

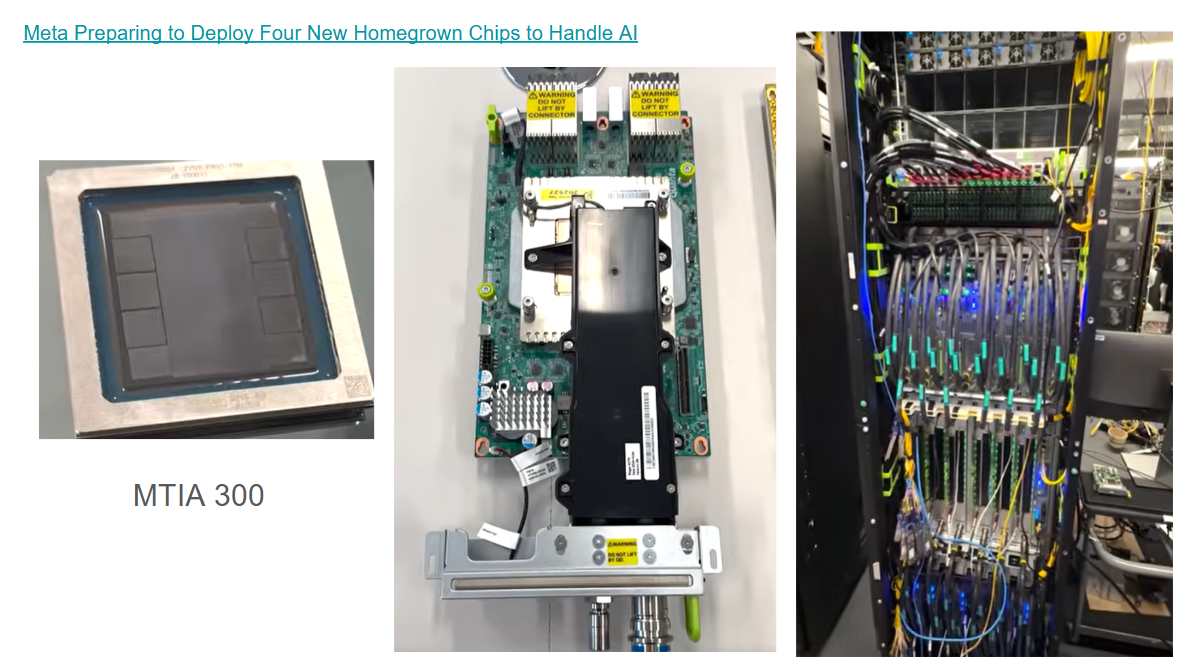

MTIA 300 の パッケージ と ボード と ラック (上に8基、下に8基で、1ラック16基)

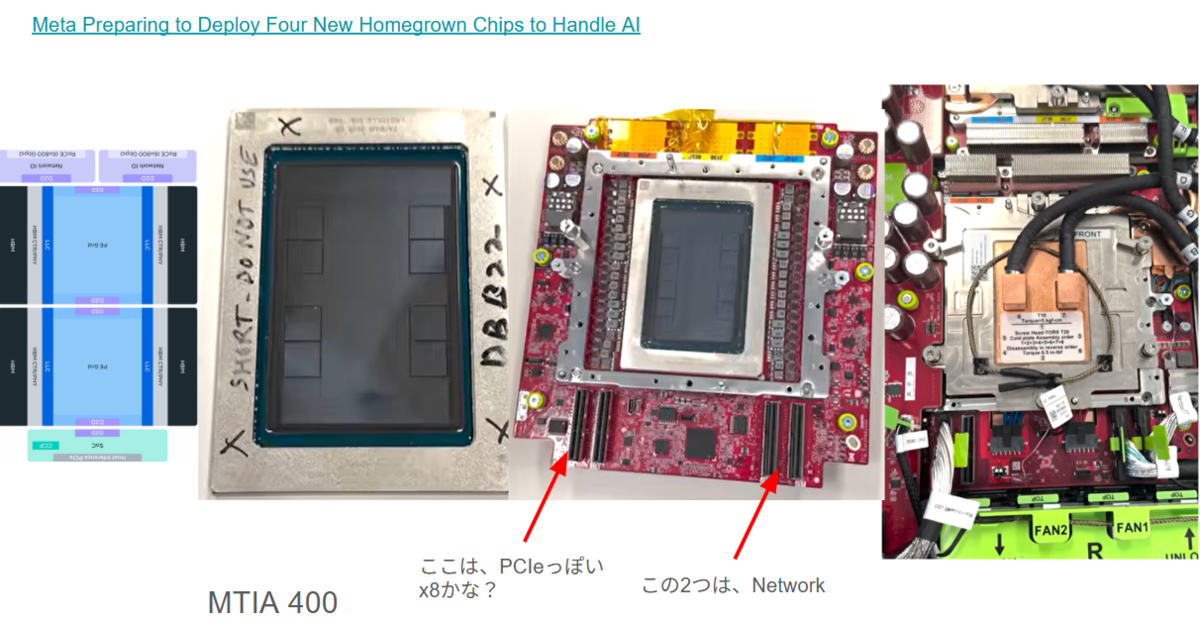

MTIA 400 の パッケージ と ボードに搭載された MTIA 400

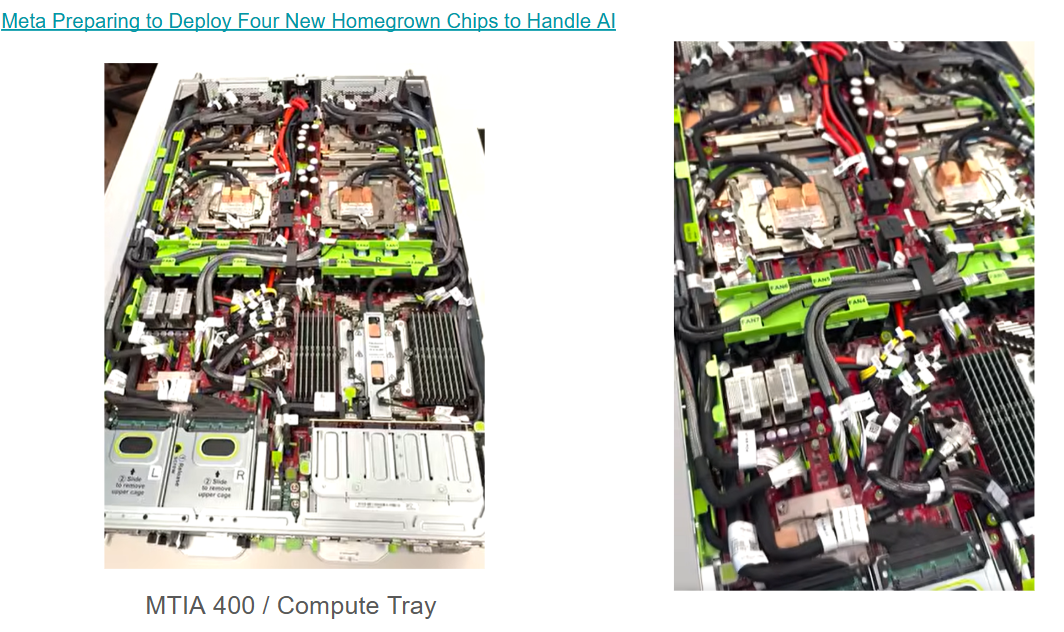

MTIA 400 Compute Tray (1基のMTIA 400、CPUは何でしょうね。8 + 8 の DRAM を接続していますね)

Chipから出ているネットワークは、紫色で各 パッケージからは1組

Grok さんの回答

MetaのMTIA(Meta Training and Inference Accelerator)は、Meta(旧Facebook)が自社で開発しているAI専用アクセラレーターチップシリーズです。主に推薦システム(Ranking & Recommendation:R&R)の推論・学習や、生成AI(GenAI、特にLlama系モデル)の推論(inference)に特化して設計されています。

2023〜2024年頃に公開されたMTIA v1 / v2(旧称MTIA 1、MTIA 2 / 2iなど)の後継として、2025〜2026年にかけて急加速した開発が行われ、MTIA 300 / 400 / 450 / 500という4世代がほぼ連続で発表・展開されています(2026年3月時点の最新情報)。

各世代の概要(2026年3月時点)

| 世代 | 主な用途・最適化対象 | 展開状況(2026年3月) | 主な進化ポイント | 備考・特徴 |

|---|---|---|---|---|

| MTIA 300 | R&Rモデルの学習(training)中心 | 数週間前に生産投入済み | R&R向け基盤強化、GenAIへの橋渡し | GenAIブーム前からのR&R最適化チップ。後続世代の基礎になった |

| MTIA 400 | GenAI + R&R(両対応)、特にGenAI推論対応強化 | テスト完了 → データセンター展開直前/開始中 | コスト・性能で商用製品と競合レベルに到達 | 72チップ規模のラック構成可能。初めて「コスト削減+競争力ある生性能」を実現 |

| MTIA 450 | GenAI推論最優先(HBM強化) | 2026〜2027年に本格展開予定 | HBM帯域がMTIA 400の約2倍(高速化) | 推論需要急増に対応。コードネーム「Arke」? |

| MTIA 500 | GenAI推論最先端(メモリ容量・帯域さらに増強) | 2027年頃の本格展開予定 | HBM帯域が450からさらに+50%、容量も大幅増 | 現時点で最も高性能。コードネーム「Astrid」? メモリヘビーな大規模推論向け |

共通のポイント(MTIA 400以降)

- 同じ筐体・ラック・ネットワークインフラを使いまわせる設計

→ 新しいチップが出ても物理的なデータセンター改修が最小限で済む(これが展開速度の速さの秘密) - 主にHBM(High Bandwidth Memory)を採用し、世代が進むごとに容量と帯域を大幅強化

- NVIDIAやAMDのGPUと競合するポジションだが、特に推論コストを下げることを最優先

- 大規模言語モデル(LLM)の事前学習(pre-training)のような超巨大トレーニングは対象外

→ Metaはそこは引き続きNVIDIA GPUを大量に使う方針 - システム例:MTIA 400以降は72チップ規模の液体冷却ラックでNVIDIA NVL72やAMD Heliosに似た構成が可能

なぜこんなに急ピッチで4世代も?

MetaのAI需要(特にInstagram/Facebookの推薦+Llamaを使った生成AI推論)が爆発的に増えているため。

GPUだけに頼ると供給リスクとコストが跳ね上がるため、自社チップでTCO(総所有コスト)を劇的に下げる戦略をとっています。

簡単に言うと:

- 300 → R&R学習の仕事馬(すでに動いてる)

- 400 → GenAI時代の本格対応チップ(いま一番注目)

- 450 / 500 → 2026-2027年の推論爆増に対応するメモリ強化版

2026年現在はまさにMTIA 400が本格展開フェーズに入り、450/500が追いかけてくるタイミングですね。

おわりに

結果的に、プロダクションの時期は、

- MTIA 100 (v1) : 2023

- MTIA 200 (v2) : 2024

- MTIA 300 : 2025

- MTIA 400 : 2026

- MTIA 450 : 2027

- MTIA 500 : 2028

って感じですかね。