はじめに

Qualcomm AI200/AI250については、Qualcomm がアナウンスしたときに下記のようにブログに残しました。

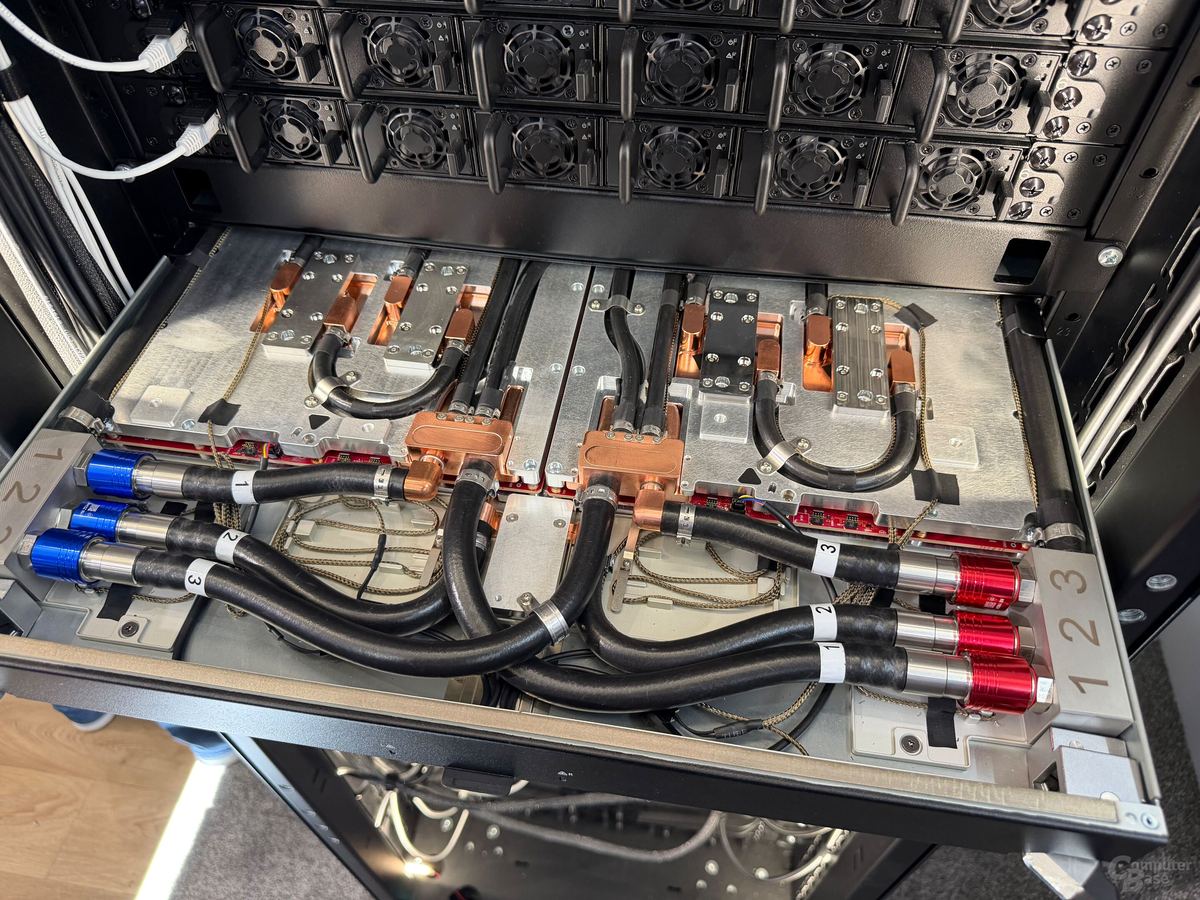

今回、展示会で Rack と Compute Node が公開され、Xのその写真が流れてきたので、記録に残します。

Qualcomm AI200 rack と compute node

以下、Xの投稿を説明のために引用します。

Got to see the @Qualcomm AI200 rack in person on the floor at MWC. It packs 56x AI accelerators with 768GB of LPDDR5 memory each, total over 43TB in the full rack. About 140 kW of max power draw. Powered with AMD EPYC CPUs I’m told. Looks QC is serious about this! pic.twitter.com/Q5IHvjEZug

— Ryan Shrout (@ryanshrout) 2026年3月2日

Server rack, built based on #AI200 board on display at @Qualcomm both at it's #MWC26 both...

— Prakash Sangam at #MWC26 (@MyTechMusings) 2026年3月3日

It looks impressive, work water cooling, back panel scale up connectivity & all.. Tack supports 56 boards...$qcom #mwc2026 #MWCbarcelona pic.twitter.com/3MAWqZZLXH

Here's a look at the @Qualcomm AI200 data center rack, live from the show floor at MWC 2026. Hat tip to my buddy @TekStrategist for the pics here. This thing sports up to 56 AI200 AI accelerators for power-efficient inferencing with 768GB of low power LPDDR5 per. These are… pic.twitter.com/nOJROi3fUP

— David Altavilla (@DaveAltavilla) 2026年3月3日

QUALCOMM DEBUTS FIRST AI 200 RACK IN PERSON AT MWC BARCELONA BOOTH #3E10 pic.twitter.com/2AbXMLY547

— Tyler (@TyPugmire) 2026年3月2日

At #MWC26, @Qualcomm demoed its rack-scale AI platform with the AI200: 768GB LPDDR per accelerator, ~43TB/rack, inference on 350B-parameter models, scaling to 1T. Target rollout: 200MW of AI infra via HUMAIN starting 2026. #DataCenterAI pic.twitter.com/lBP9WAWxTk

— Prabhu Ram (@prabhu_ram) 2026年3月3日

Compute Node の構成

下記の記事に、Rack と Compute Nodeの写真がいっぱい載っています。

下図を上記の記事から説明のために、引用します。

Compute Nodeには、大きなヒートシンクが2個あります。1個のヒートシンクの下には、チップがありそうです。

記事の解説によると、

Qualcommのラックのレイアウトは若干異なります。AI200を2基搭載した小型の1Uトレイが4つ、5Uの高さのスタックに収められています。このスタックには、さらに1Uトレイに水冷式のAMD Epycプロセッサを2基搭載しており、アクセラレータトレイとCPUトレイの比率が4:1のコンピューティングスタックが完成します。

1U の (AMD EPYC x 2)の Host + 1U x 4 の (AI200 x 2) の構成

このシステムが7個でRackを構成

- 7 x 2 = 14個の AMD EPYC CPU (ここからネットワークが4本 + 1本)

- 7 x 8 = 56 個の AI200

5Uで1システム x 7 = 35 U + 電源 + Ethernet Switch って感じですね。

おわりに

この AI200 Rack って、他の会社のどのぐらいのシステムに対応するんですかね。

$QCOM AI200 will likely deliver worse performance than $AMD MI355X or $NVDA B200, and it’s expected to launch around the same time as MI450 and Vera Rubin

— Daniel Romero (@HyperTechInvest) 2026年3月3日

Just like $INTC, $QCOM is probably late to the party

The tokenomics will hardly be competitive pic.twitter.com/NWhnjWsigy