はじめに

SambaNova Systems が SN40L を発表したのが、2023年9月19日

既に、2年5か月が経ちました。

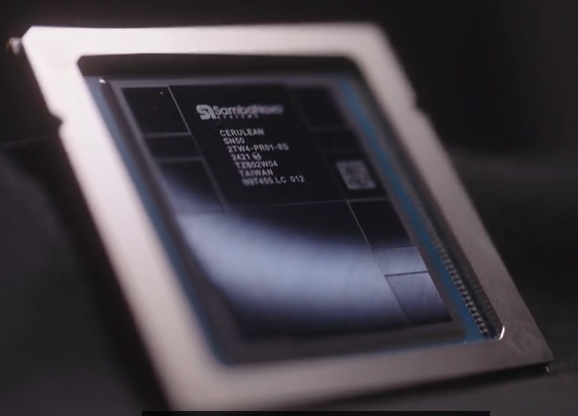

2026年2月24日に、SN50を発表しました。

SN50 is here, the fastest chip built for agentic AI.

— SambaNova (@SambaNovaAI) 2026年2月24日

Max speed of up to 5X faster; run agentic AI at a 3X lower cost than GPUs, unlocking cloud-scale inference economics.

We’ve also planned a multi-year strategic collaboration with @intel &raised $350M+ from @Vista_Equity,… pic.twitter.com/2lBNZdSWc7

SN40L の振り返り

SN40L は、

- TSMC N5

- 102B トランジスタ

- 1040 RDU

- 638 TFLOPS(FP16)

- 520MB SRAM

- 64GB HBM (HBM 8GB x 8)

- 1.5 TB DDR

です。

このブログでは、下記のように取り上げました。

- SambaNova の SN40L

- SambaNova SN10/SN20/SN30/SN40Lを振り返る

- SambaNova Systemsは、LLMの推論にPIVOTしたの?

- SambaNova SystemsもGbEを付けてくる?

- SambaNova SN40L、Hot Chips 2024で詳細が公開される

- SambaNova の SN10/SN30/SN40L の内部接続について

- SambaNova Systems : SN40 Rackの裏側

SN50

SambaNova Unveils Fastest Chip for Agentic AI, Collaborates with Intel, and Raises $350M+

New SN50 chip boasts a max speed of 5X faster than competitive chips

とあるが、SN40L との差は分からない。。

- Run agentic AI at a 3X lower cost than GPUs – slashing inference costs and maximizing margins

コスパは、GPUより3倍以上イイのね。

- SoftBank Corp. will be the first customer to deploy SN50 within its next‑generation AI data centers in Japan

Softbank がファーストカスタマーなんだね。

SN50 は、

ぱっと見、SN40L と同じだね。

SambaRack SN50 delivers 5X more compute per accelerator and 4X more network bandwidth than the previous generation.

- 計算能力 : SN40L の 5倍

- ネットワークの帯域 : 4倍

下記のブログにて、Ethernetを導入することが変わっていたので、400G or 800G ですかね。

によると、

SN50 will deliver a 2.5x higher 16-bit floating-point performance and 5x higher perf at FP8 Each RDU features 432 MB of on-chip SRAM, 64 GB of HBM2E memory good for 1.8 TB/s of bandwidth, and between 256 GB and 2 TB of DDR5 memory.

とあります。FP16は 2.5xで、FP8 で 5x なんですね。

SRAMは、520MBから432MB、HBMは64GBで同じ。DDRは 1.5T => 256GB~2TB

Just like the SN40L RDU, the SN50 RDU features a tiered memory architecture that combines large‑capacity memory, high‑bandwidth memory (HBM), and ultra‑fast SRAM. This hierarchy enables the chip to host the largest models while simultaneously running many models in parallel.

メモリは、SN40L と同じ感じなんだね。

Interconnected SambaRacks can scale up to 256 accelerators over a multi‑terabyte‑per‑second interconnect, which cuts TTFT and supports larger batch sizes.

SN50 は、256個まで接続可能なんだね。

RackもSN40Lと同じっぽい

おわりに

2H.2026ということなので、年内に導入されれば、OKということですかね。

SN40Lと比べて、FP16が 2.5x って、どうやって実現したんですかね。N5 => N3 になって、2.5x になるのは、計算器の数だけでなく、動作周波数も上げる必要があると思うんだけどね。

関連記事)、2026.02.27

www.nextplatform.com