はじめに

CES 2026 にて、発表になった、NVIDIA Vera + Rubin Compute Tray が凄かったので、記録に残します。

詳細は、下記の動画で。

こちらでも。

NVIDIA unveils Vera Rubin : up to 10× lower cost per million inference tokens and 4× fewer GPUs for MoE training vs Blackwell, plus ~5× better network power efficiency via Spectrum‑X Ethernet Photonics. Partner availability : H2 2026. pic.twitter.com/u8VGnRzFSj

— DailyXplorer (@DailyXplorer) 2026年1月6日

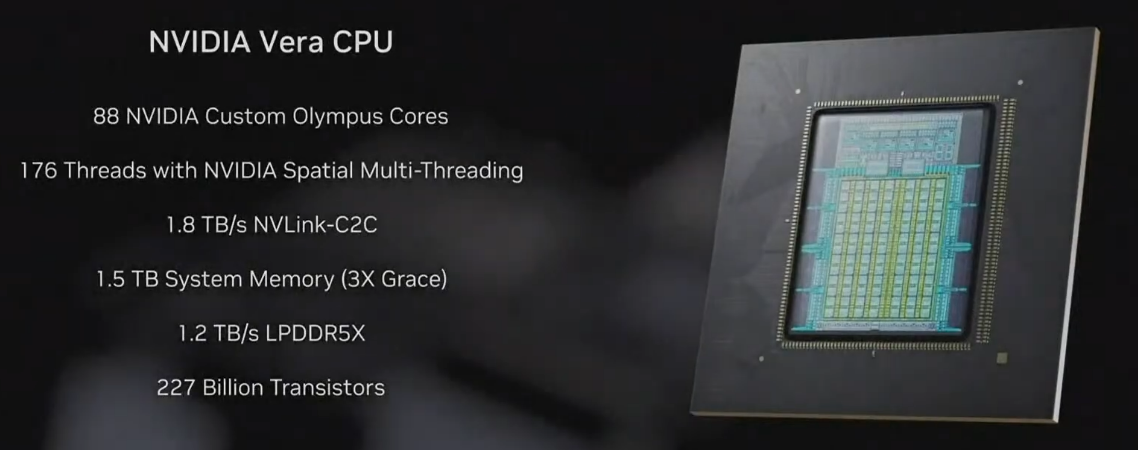

- 88 NVIDIA Custom Olympus Cores

- 176 Threads with NVIDIA Spatial Multi-Threading

- 1.8 TB/s NVLink-C2C

- 1.5 TB System Memory (3X Grace)

- 1.2 TB/s LPDDR5X

- 227 Billion Transistors

Multi-Threading 対応なんですね。これ、独自コアなんですかね。

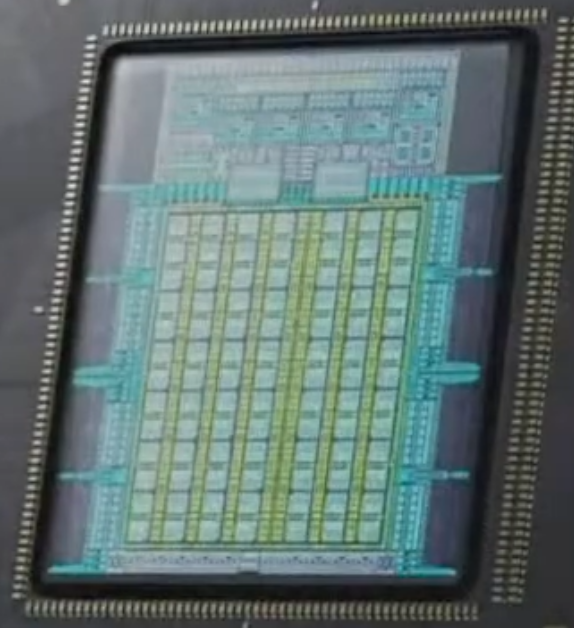

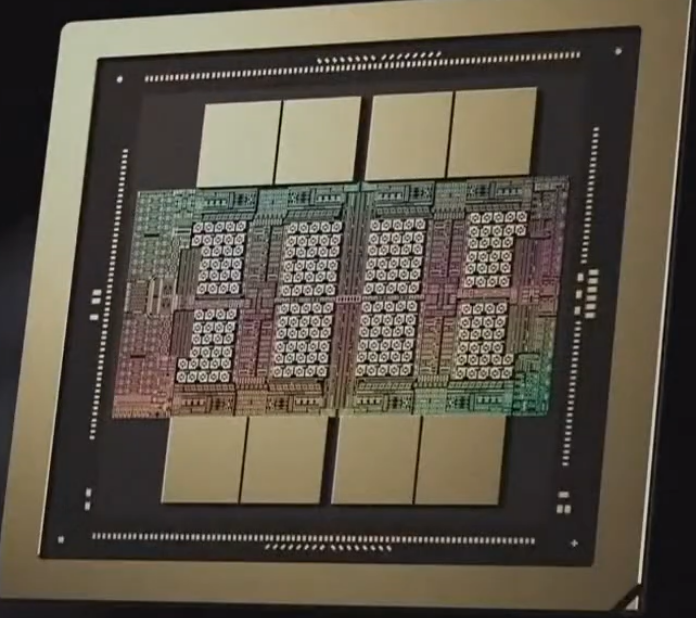

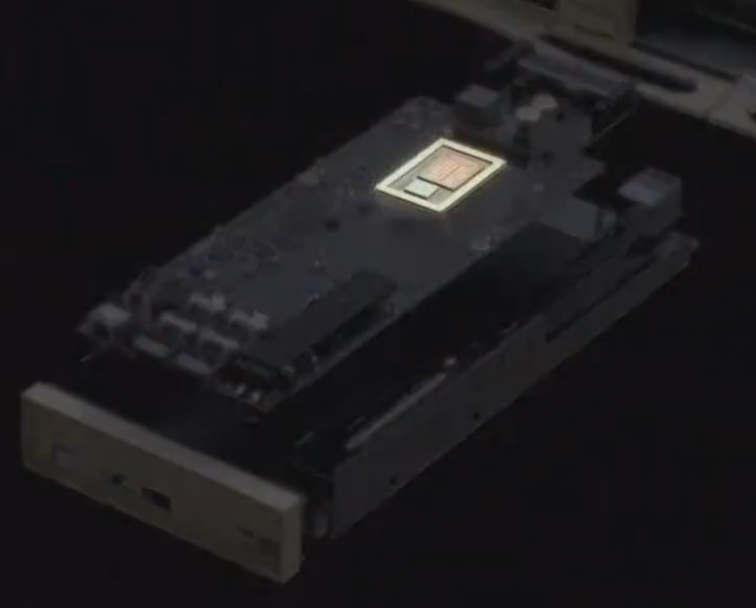

Die の部分を拡大。

- CPU Die

- I/O Die

構成。

- LPDDR5X x 8 Channles

- PCIe Gen6 x 16 x 4 : I/O Die

- NVLink-C2C : CPU Die の下側

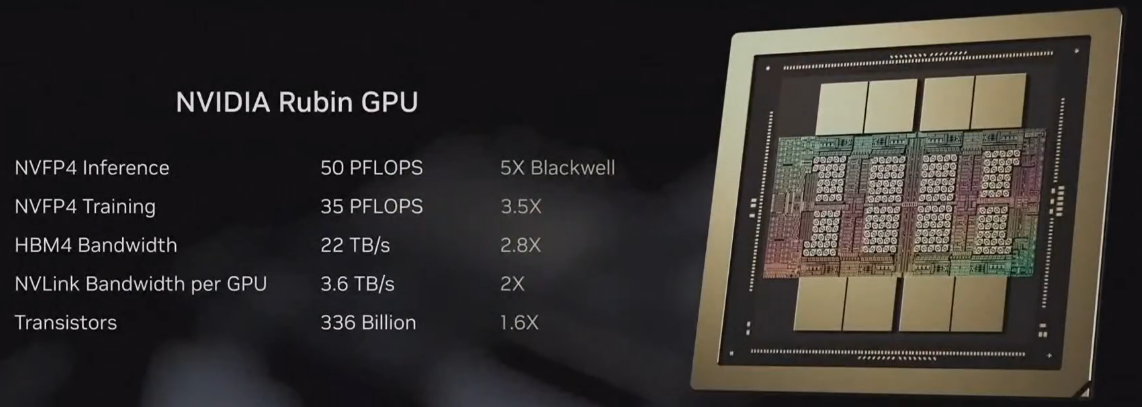

Rubin

Die の部分を拡大。

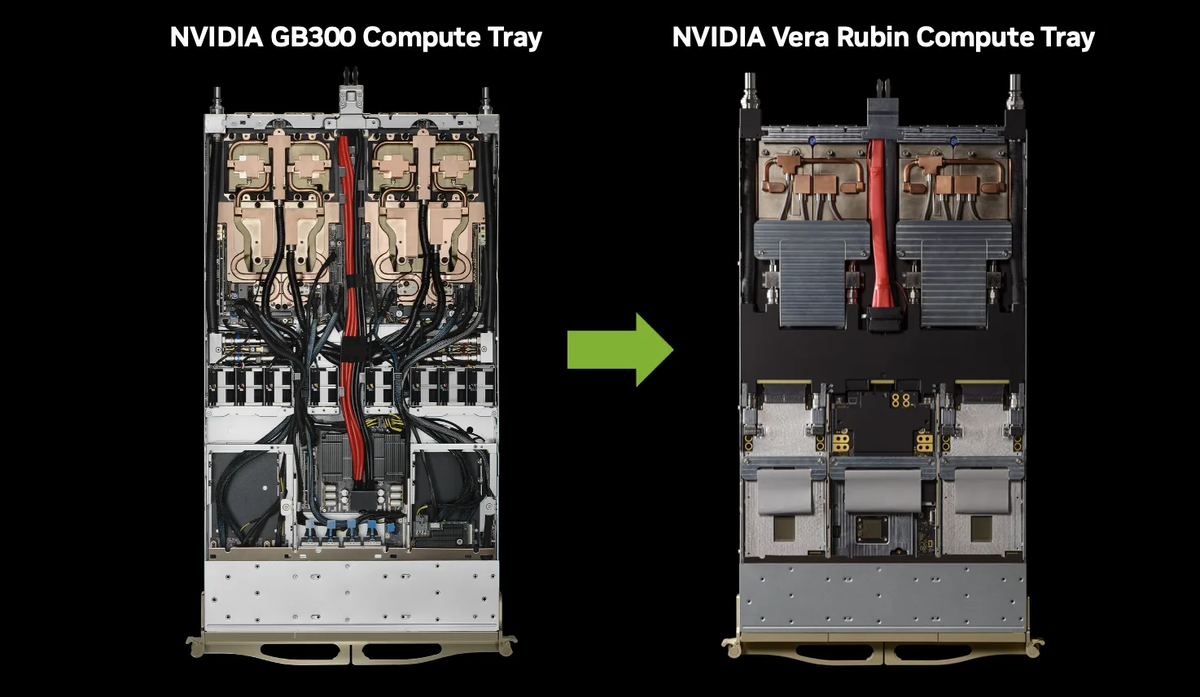

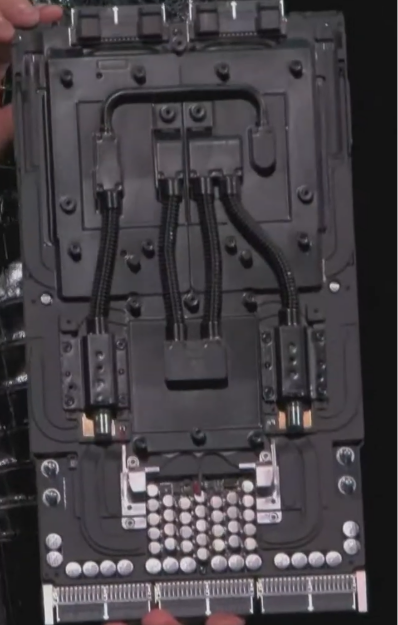

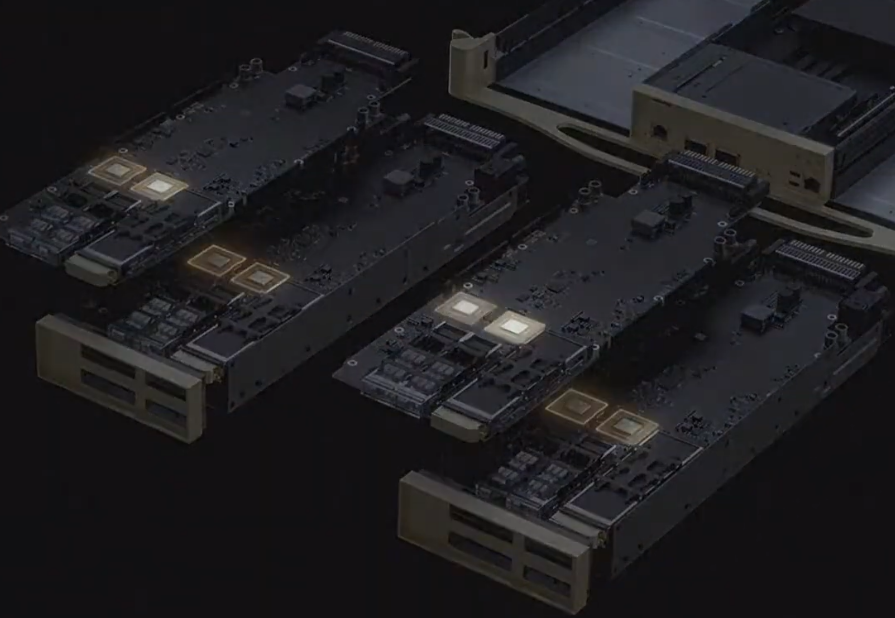

Vera + Rubin Compute Tray

Vera + Rubin Moduleは、下のコネクタでスライドにて、接続。

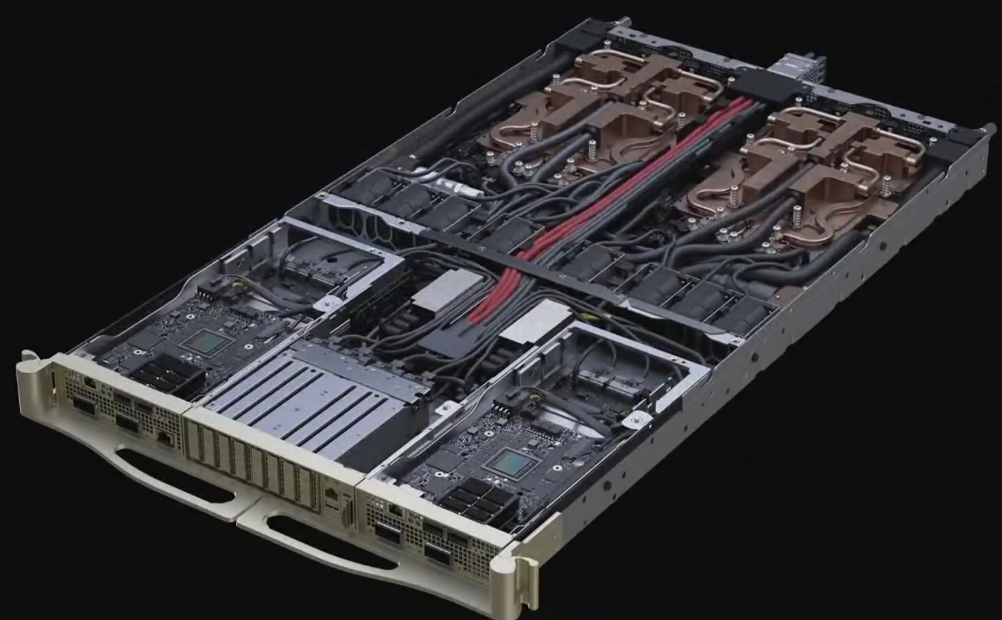

Grace + Blackwell の Compute Tray

各モジュールは、ケーブルで接続。

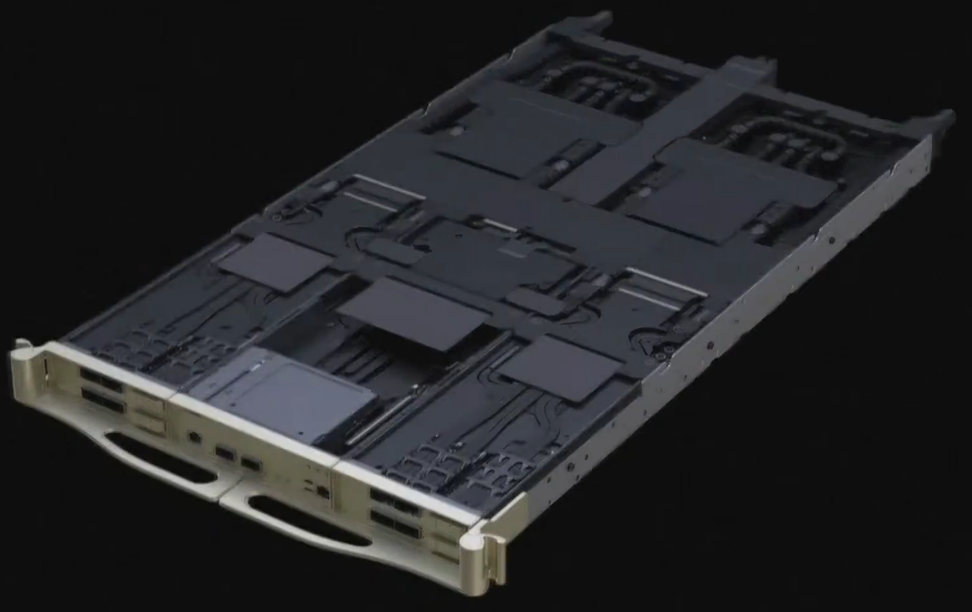

Vera + Rubin の Compute Tray

ケーブルが無い!

ConnectX-9 もモジュール化。ConnectX-9 が2個載っている。

BlueField-4 もモジュール化。

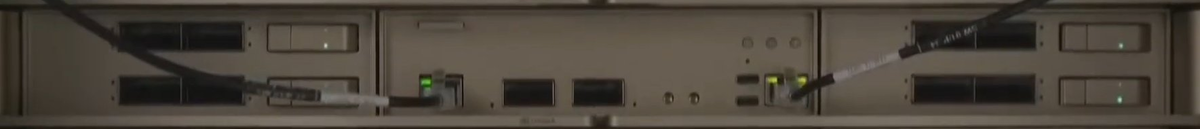

コネクタ部

- 両サイドは、(ConnectX-9 x 4 ) x 2

- 真ん中の左側は、BlueField-4 の BMC用、ConnectX-9

- 真ん中の右側は、Compute Tray の BMC

ケーブルは、2マイル

講演の中で、ケーブルは、2マイルあると言っていたのですが、下記のXの投稿にてケーブルの様子が分かります。

$NVDA $CRDO

— ユーエスさん🇺🇸米国株投資🍺🥃🍷🍶⚽ (@us_stock_invest) 2026年1月7日

CESのNVIDIA講演でケーブルレスにすると言及したのは左の「サーバー内」のケーブル

Credoの主力であるAECは右のような「サーバー外」のケーブル

同じ「ケーブル」でも色々あるんですね〜

あと同講演でラック背面に2マイルの銅線が使われ、依然として銅が最適であるとも語ってました😇 pic.twitter.com/zDSDz6dwQ3

これは、Vera + Rubin ではなく、Grace + Blackwell ですね。

記録のために、右の画像を引用します。真ん中の Ethernet/IB Switch Rack に繋がっているんですね。

おわりに

Compute Tray の組み立て時間

- Blackwell の Compute Tray の組み立て時間、2時間

- Rubin の Compute Trayの組み立て時間、5分

120分が5分になって、生産性が爆上がり。ただし、各モジュールの製造時間の比較が無いので、全体でどのぐらいの生産性が向上したかはわかりません。

それにしても、メンテナンス性はかなりいいんじゃないですが、取り換えるだけですからね。

NVIDIA公式のブログ

にもっとわかりやすい写真がありましたので、引用します。