はじめに

- MI350X

- MI355X

- MI400

の発表がありました。

MI350X/MI355X

PC Watch の記事に詳しく書いています。

MI300X/MI325X、と、MI350X/MI355X の違いは、

- 半導体プロセスが、N3P (MI300X/MI325X は、N5)

- IOD が 2個 (MI300X/MI325X は、4個)

- CUが32個 (MI300X/MI325X は、38個)

- FP16/FP8 の性能は約2倍

- FP6/FP4 をサポート

IODが2個になりましたが、IOD間は、Infinity Fabric AP(Advanced Package)で接続するという構造は共通であり、5.5TB/sの双方向通信が可能になっている。ということです。

MI300のInfinity Fabric APについては、下記のブログでも紹介しました。

MI300 の時の Infinity Fabric AP の帯域は、ここにもありますが、

- 2.4 TB/s/dir

- 3.0 TB/s/dir

合計で 5.4 TB/s/dir なので、大体同じ帯域です。

メモリの帯域と容量は、

- MI300X : 5.3 TB/s、192GB

- MI325X : 6 TB/s、256GB

- MI355X : 8 TB/s、288GB

MI325Xの対して、帯域は33%増。FP8の性能は、5.2 PFLOPS => 10 PFLOPS です。約2倍になっています。

メモリ帯域が 33%増で、計算性能が約2倍だと、バランス悪そうですが、NVIDIAのGPUも同じ感じなんでしょうがないですね。

MI400

詳細は、PC Watch の下記の記事にまとまっています。

MI400 は、

- FP8 (20 PFLOPS), FP4 (40 PFLOPS)

- MI355Xは、FP8 が 10 PFLOPS, FP4 が 5 PFLOPSなので、2倍

- HBM4 : 432 GB, 19.6 TB/s

- スケールアウト帯域 : 300GB/s

メモリが 432GB だと、8個のHBM4では 1個 54GBと中途半場。12個のHBM4では、36GB。こちら。

性能は2倍で、メモリ帯域が 2.4倍。HBM4は、2048 pin なので、HBM3e の 1024 pin の2倍。メモリ数が 8個から12個で1.5倍。

19.6 TB/s = 1個当たりの帯域 x 12 となり、1.633 TB/s = 6.38 Gbps

MI355X の 8TB では、HBM3e 1個当たり 1TBとなり、7.8125 Gbps

で、1 pin あたりの帯域は下がるんですね。

メモリチャンネル数は、

- MI355X は、1個当たり16チャネルなので、16 x 8 = 128 チャンネル

- MI400 は、1個当たりの32チャンネルなので、32 x 12 = 384 チャンネル

計算機性能は2倍なので、計算機の数を2倍にすれば実現できる。そうなると、メモリのチャネルも2倍にしないといけないが、HBM3e => HBM4 にすると、2倍になる。しかしながら、1ピンの転送帯域が下がるので個数を12個の1.5倍で帯域を確保するって、感じです。

ノード構成

MI400 になると、ノード構成は、下記のようなボードになります。NVIDIAのGB200やVR200のようなものですね。しかしながら、CPUは、1個です。GPUは4個。Network Chipは2個。

下記はスライドにはなくて、講演で出てきました。

下記のように、MI300XやMI325Xのように、1ノード8GPU構成から、1ノード4GPU構成に

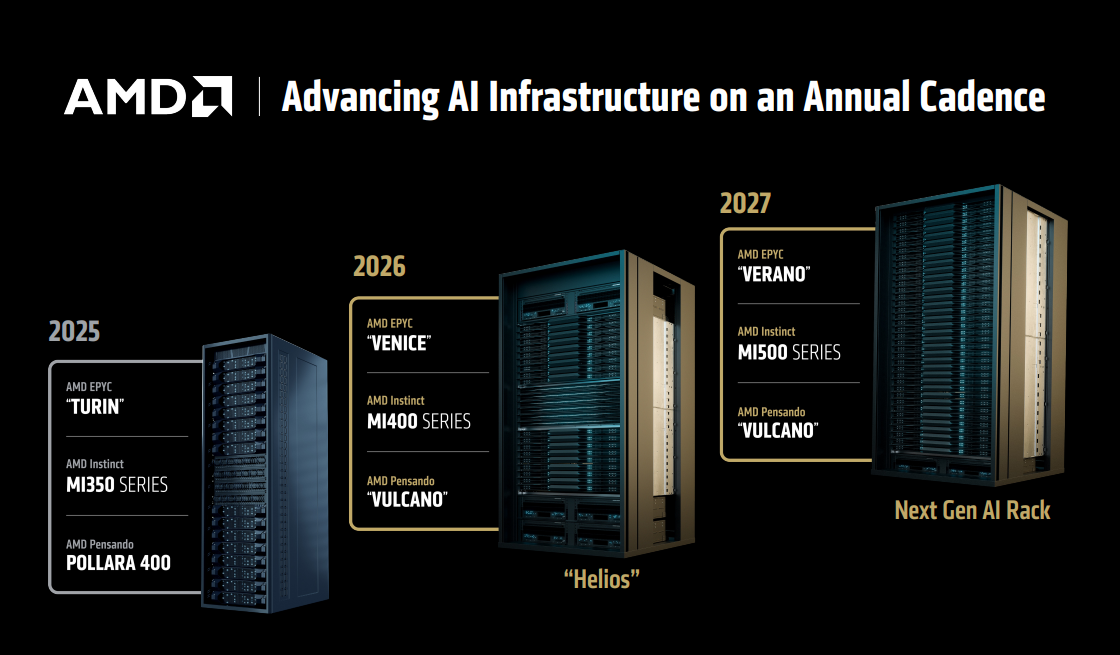

Rach 構成

Rackも幅が広がっています。NVIDIAのGB200/GB300のような感じですかね。

MI400搭載の「Helios」

MI500

MI500搭載のRackも発表。

おわりに

NVIDIA が GB200をベースにして、Rackベースになったことになり、それに追従するように、AMD も MI400 から Rack ベースになりました。

2021年9月の下記のブログでも最後に書きましたが、AI System が当たり前になりました。

となると、

- CPU

- アクセラレータ

- Network

を持っていないと、勝てないことになり、今後は、デバイスを売る会社としては、

になりそうな気がします。