はじめに

Xに流れてきた下記の投稿。FPGAでLLM Inference するの?

なんだコレ

— Vengineerの妄想 (@Vengineer) 2025年2月18日

FPGAでLLM Inference https://t.co/L8pg3FK3yf

Positron AI という会社について、記録に残します。

Positron AI

サイトは下記

Leadership Team の8名の内、CEOのMitesh Agrawalさん以外は、Groqから

- CEO : Mitesh Agrawal

- CTO & Founder : Thomas Sohmers

- Chief Scientist & Founder : Edward Kmett

- Executive Vice President of Engineering : Greg Davis

- COO : Bernie Sardinha

- VP, Sales & Business Development : Cameron McCaskill

- Chief of Staff : John Fry

- Chief Architect : Jim Sproch

Product

このビデオに載っていました。

下図は、上記のビデオから説明のために引用します。

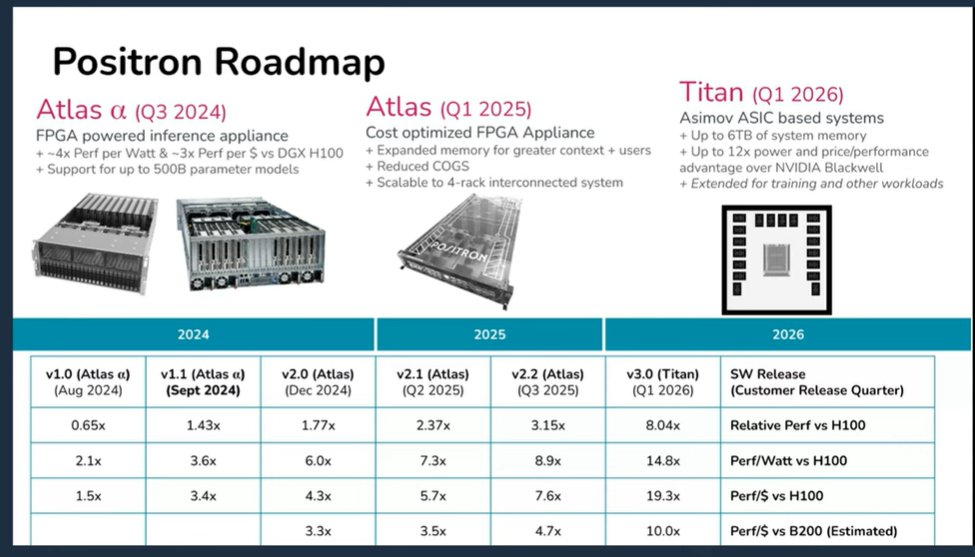

- v1.x : Altas α (Q3.2024) : FPGA ベース

- v2.x : Altas (Q1.2025) : FPGA ベース

- v3.0 : Titan (Q1.2026) : ASIC ( 6TB メモリ)

v2.x の Altra は、Alera Agilex 7 M-Series FPGAs に実装

上記の画像は、下記のビデオから説明のために引用します。

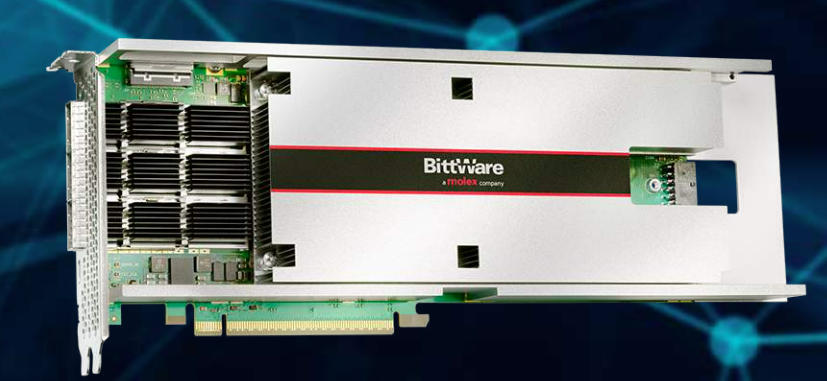

このボードは、どうやら、Bittware 社製ボードのようです。

Agilex 7 Mシリーズだと、下記の IA-860m っぽいです。説明のために画像を引用します。

上のビデオのボードと似ていますよね。

Agilex 7 M シリーズなので、

- PCIe Gen5 + CXL

- HBM2e

- 400G ethernet

が使えます。

ASIC 化

現時点のメンバーを Linkedin で調べると、インフラ関連の人達が多いです。ASIC化のために、Director ASIC Engineering を募集していたようですが、既に募集は終わっています。

ポイントは?

で、何に強みがあるのか?下記のように、1ラック当たりの電力が 10K Watt なので、DGX H100の5900Wだと、1基しか搭載できないが、Positron AIのサーバーは、2,000Wなので5基搭載できるということです。

とは言え、1基のDGX H100と5基の Positron AIのサーバーの性能がどうか?ということにはなりますが。。。。

下記のスライドに、H100/B200 の比較があります。Perf/Watt と Perf/$ はいいよ!ということのようです。絶対性能が高いとは言っていませんね。

おわりに

FPGA関連で言えば、Xlinxが買収した

がありましたが、今、どうなっているでしょうかね。。。

FPGAでLLM Inference と思いましたが、ASICまでにつなぎという感じですかね。。。。

で、6TB のメモリって、どんな感じなんでしょうかね。。。。