Alibaba CloudのQwenチーム(Tongyi Lab)が4つの小型モデル「Qwen3.5 Small」シリーズをリリースしました。モデルのサイズ(パラメーター数)は0.8B(8億)、2B(20億)、4B(40億)、9B(90億)の4種類で、スマートフォンでも動作可能という点が特徴です。

Qwen3.5はQwenチームが開発する大規模言語モデルで、日本語を含む多種多様な言語・方言をネイティブにサポートしているのが特徴です。

GPT-5.2と同等クラスの中華AI「Qwen3.5-397B-A17B」がオープンモデルとして登場 - GIGAZINE

今回発表されたQwen3.5 SmallシリーズはQwen3.5と同じネイティブマルチモーダルモデルで、Qwen3.5と同様にGated Delta NetworkとMixture of Experts(MoE)機構を組み合わせたアーキテクチャ、拡張強化学習を用いて構築されています。Qwenチームによれば、0.8Bと2Bは「小型かつ高速でエッジデバイスに最適」、4Bは「軽量エージェント向けの驚くほど強力なマルチモーダルベース」、9Bは「コンパクトながら、はるかに大規模モデルとの差はすでに縮まっている」と評価しています。

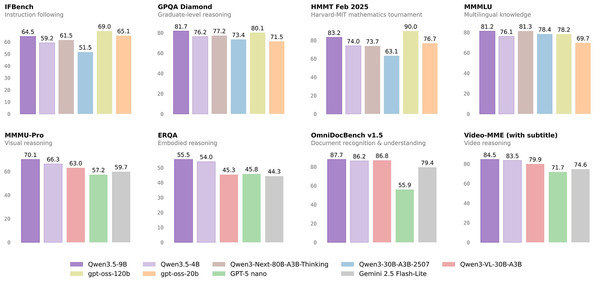

Qwen3.5-9B(紫)とQwen3.5-4B(薄紫)を、Qwen3-Next-80B-A3B-Thinking(茶)、Qwen3-30B-A3B-2507(青)やQwen3-VL-30B-A3B(赤)、gpt-oss-120b(黄)、gpt-oss-20b(橙)、GPT-5 nano(緑)、Gemini 2.5 Flash−Lite(灰)と比較してベンチマークテストをした結果が以下。

gpt-oss-120b、gpt-oss-20b、Qwen3-30B-A3B-Thinking、Qwen3-30B-A3B-Thinking-2507、Qwen3.5-9B、Qwen3.5-4Bのベンチマークスコアを並べた表。Qwen3.5-9BとQwen3.5-4Bは推論・コーディング(Reasoning & Coding)だと他モデルより劣りますが、それ以外ではほぼ同等のスコアをたたき出しています。

文章認識・文書理解(Text Recognition and Document Understanding)や動画理解(Video Understanding)のスコアを見ると、Qwen3.5-9BやQwen3.5-4Bはgpt-oss-120b・gpt-oss-20bを大きく越えています。

Qwen3.5 Smallシリーズは4種のモデルと各ベースモデルがHugging Faceで公開されています。

Qwen (Qwen)

https://huggingface.co/Qwen/models

また、各種AIをローカルで実行できるアプリ「Ollama」でもQwen3.5 Smallシリーズを利用可能です。

qwen3.5:9b

https://ollama.com/library/qwen3.5:9b