Instagramで、10代の子どもが自殺や自傷行為に関連する用語を検索した際に親へ通知するシステムを導入することをMetaが明らかにしました。

New Alerts to Let Parents Know if Their Teen May Need Support

https://about.fb.com/news/2026/02/new-meta-alerts-let-parents-know-if-teen-may-need-support/

Metaによると、Instagramでペアレンタルコントロールを有効にしている保護者に対し、10代の子どもが短期間に自殺や自傷行為を助長する用語を繰り返し検索した場合に通知する仕組みを導入するとのこと。

通知は登録された情報に応じて電子メールやテキストメッセージ等で送信されるほか、アプリ内通知としても表示されます。同時に、保護者は子どもに向き合うための専門リソースを閲覧することもできます。

Metaは「保護者が介入できるよう支援することが重要だが、通知を過度に送信することで有用性が低下することは避けたい」と考えていて、自殺・自傷行為ケアの専門家と協議した上で、「短期間で数回の検索」という基準を設定しました。一方で慎重に子どもを保護することも重視した結果、実際には深刻な懸念がない場合でも通知される可能性があるそうです。

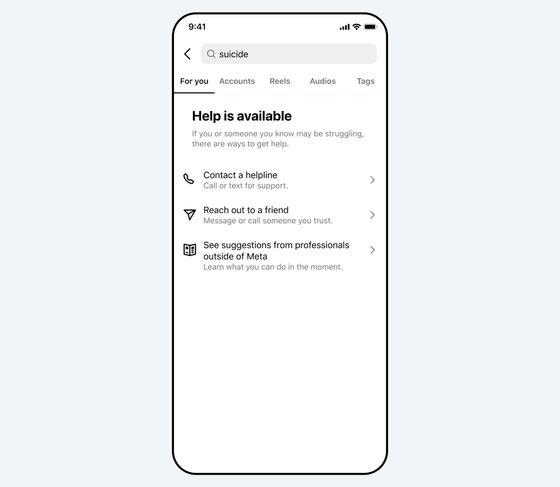

なお、自殺や自傷行為に明確に関連する表現はInstagramで検索しても出てこないようになっていて、代わりに支援を提供するリンクや地域の関連団体へ誘導されます。また、検索が自殺や自傷行為に明確に関連していない場合でも、広い意味でのメンタルヘルスに関するものであれば、リソースやヘルプラインへ誘導されます。

これらの仕組みは、2026年3月初週にアメリカ、イギリス、オーストラリア、カナダにおいて展開され、2026年後半に他の地域にも拡大される予定です。

加えて、MetaはAIを使う子どもの会話を検知して保護者に通知する仕組みも導入する予定です。Metaによると、10代の子どもは支援を求めてAIを利用するケースが増えているそうで、MetaのAIは必要に応じてリソースを提供するよう訓練されているものの、自殺や自傷行為に関連する会話を始めるなど特定の状況においては保護者にも通知するよう設計し直すとのこと。この取り組みについては今後数カ月以内に詳細を共有するとしています。