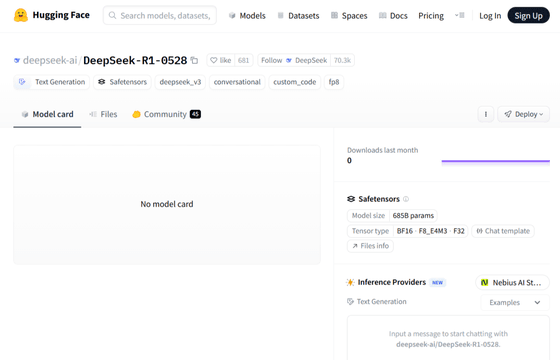

中国のAI企業であるDeepSeekが、推論AIモデルのDeepSeek R1をマイナーアップデートし「DeepSeek-R1-0528」をリリースしたと中国SNSのWeChatで発表しました。Hugging Faceのリポジトリにはモデルの説明は含まれておらず、モデルの動作を導く内部コンポーネントである設定ファイルと重みのみが含まれています。

deepseek-ai/DeepSeek-R1-0528 · Hugging Face

https://huggingface.co/deepseek-ai/DeepSeek-R1-0528

マイナーアップデートされた「DeepSeek-R1-0528」はパラメーター数6850億で、やや重みが増しています。アップデート内容は主に推論能力の向上で、「Googleモデルのように深く推論するようになった」「コード生成課題の改善」「速いだけでなく思慮深い、独特な推論スタイル」「1つのタスクにつき最大30~60分という長時間の思考セッション」が特徴だとのこと。

R1-0528 feels... aware ????

— Chetaslua (@chetaslua) May 28, 2025

???? New DeepSeek R1-0528 Update Highlights:

• ???? now reasons deeply like Google models

• ✍️ Improved writing tasks – more natural, better formatted

• ???? Distinct reasoning style – not just fast, but thoughtful

• ⏱️ Long thinking sessions – up to… pic.twitter.com/mkeQVIWlQk

コードの生成や修復、コード実行、出力予測など広範なコーディングでベンチマークを行うLiveCodeBenchではすでにDeepSeek-R1-0528がランキングに掲載されています。DeepSeek-R1-0528の順位(2024年8月1日~2025年5月1日)は記事作成時点だと4位で、OpenAIのo4-mini(medium)とほぼ肩を並べる性能を示すスコアが掲載されています。

R1-0528 is vastly more comfortable *being*

— Teortaxes▶️ (DeepSeek 推特????铁粉 2023 – ∞) (@teortaxesTex) May 28, 2025

New vs old: https://t.co/ejtIxjo8DB pic.twitter.com/mpjpyFawwH

DeepSeek-R1-0528に、Trasformerアーキテクチャを発表した論文「Attention Is All You Need」を読ませて要約させているところが以下。

DeepSeek R1 0528 can understand some details in the article, and the answers are more logical, comprehensive and complete!

— Vincent (@AwadbVincent) May 28, 2025

Try freely in Zotero by the plugin PapersGPT(https://t.co/WTk5KA7JVa) to read papers with the newest DeepSeek model DeepSeek R1 0528. pic.twitter.com/XD2aPbMGXD

なお、Deepseek-R1-0528はMITライセンスのもとで公開されており、誰でも無料でモデルデータを入手できます。

◆つづき

中国製高性能AIモデル「DeepSeek-R1-0528」はGoogleのAI「Gemini」を使用して蒸留した可能性ありとの臆測が飛び交う - GIGAZINE