オープンソースAIモデルの開発を行うRecursal AIが、パラメーター数が70億(7B)帯のモデルの中では最も優秀な多言語パフォーマンスを示すというモデル「EagleX」をリリースしました。記事作成時点では、1.7兆トークンでトレーニングした「EagleX 1.7T」が公開されています。

🦅 EagleX 1.7T : Soaring past LLaMA 7B 2T in both English and Multi-lang evals (RWKV-v5)

https://substack.recursal.ai/p/eaglex-17t-soaring-past-llama-7b

EagleXはオープンソースのアーキテクチャ「RWKV-v5」に基づいて構築されたモデルです。RWKVはコンテキストサイズが大きい他のTransformer(系列変換モデルのひとつ)と比較して推論コストが10倍から100倍低く、実行時およびトレーニング時のリソース使用量が削減されます。

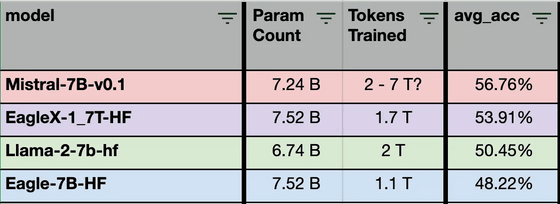

EagleX 1.7Tは、RWKVの性能に基づいて100以上の言語にわたる1.7兆のトークンでトレーニングされた、パラメータ数7.52B(75億2000万)のモデルです。

多言語ベンチマークを実施した結果、EagleX 1.7Tは同じ7B帯のモデルをすべて上回るパフォーマンスを発揮し、英語に至っては複数のベンチマークで条件付きながらLLaMA-2-7Bを超えたとのこと。

EagleX 1.7Tを実際に使用したユーザーからは「DeepLや他のモデルと比較して、翻訳タスクで良い成績を収めました。Gemini Proは良い結果を出せず、GPT 3.5とMistral mediumだけがより正確な翻訳ができました。ただし、フランス語とヨーロッパのマイナー言語との翻訳が課題だと感じました。間違いは多いですが、語順はより自然で、弱点は言葉の使い方だけでした」との声が寄せられています。

Comment

byu/Someone13574 from discussion

inLocalLLaMA

2024年3月後半に、完全版のEagleX 2Tが公開される予定。今回のEagleX 1.7Tはあくまで主要なマイルストーンに到達したという情報共有と研究を目的にリリースされたものです。

EagleX 1.7TはApache 2.0ライセンスに基づいて使用できます。

recursal/EagleX_1-7T · Hugging Face

https://huggingface.co/recursal/EagleX_1-7T