ユーザーレビューの自動承認システムに生成AIを活用する取り組みについて説明します。従来の人手による承認プロセスの課題を解決し、効率化を図るための新たなアプローチを紹介します。

- 1. はじめに

- 2. 現状と課題

- 2. 不適切なレビュー

- 3. 生成AIの現状と可能性

- 4. システム構成

- 5. 生成AIのモデル構築

- 6. プロダクトへの実装

- 7. 自動化に向けた課題

- 8. 今後の対応

- 9. まとめ

- 補足

1. はじめに

プラットフォーム事業本部 ユーザーレビューグループの松井です。

今回は、レビューの自動承認の対応についてお話しします。

2. 現状と課題

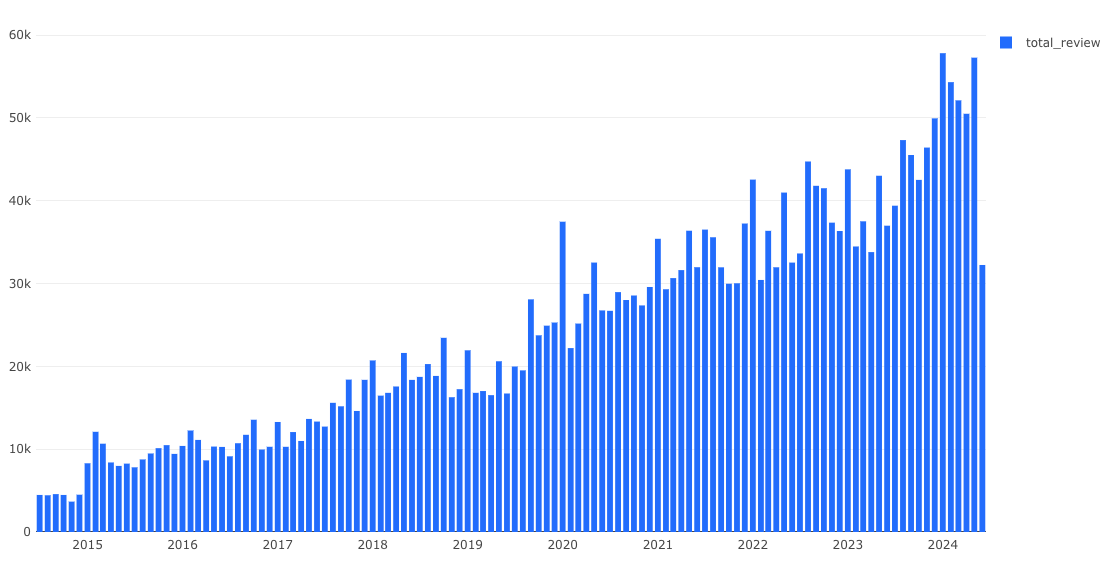

DMMでは、毎日1000件以上のレビューが投稿されており、その数は年々増加傾向にあります。過去10年でレビュー投稿数は10倍増加しています。

これらのレビューはコンテンツの品質向上に貢献する一方で、不適切な内容を含むものも存在します。現在、すべてのレビューは人手による承認作業を経て公開されていますが、年々、この作業は時間とリソースを大きく消費するようになりました。[1]

そこで昨今話題になっているようなChatGPTをはじめとする生成AIを活用し、レビュー承認作業そのものを自動化したいという提案があり、取り組むことになりました。

2. 不適切なレビュー

投稿されたユーザーのレビューは規約[2]に基づき、掲載に適切か不適切かを判断されます。

不適切なレビューとして、例えば以下の事例が存在します。

- 誹謗中傷:作品や出演者を不当に批判するレビュー

- 苦情:サービスや運営に対する不満を表明するレビュー

- 文言不明:意味不明な文章

- 購入非推奨:他のユーザーに商品を購入しないよう勧めるレビュー

これらの不適切なレビューは、現状投稿されるレビューの中にある程度の割合で含まれます。

また、放置するとコンテンツの売上にも大きく影響します。

3. 生成AIの現状と可能性

3.1. 生成AIの現状

2024年7月現在の生成AI技術の活用は、一般的にはリスクの低い分野(テキスト要約、社内文章検索、Q&Aなど)に限られています。

しかし、今回我々が取り組もうとしているのはレビューの適正を判断し、人の作業を自動化するリスクの高い分野で、レビューの内容によってはAIの誤りが1%も許容できないことがあります。このようなケースにおいて生成AIを使用することは、業界の中でも比較的、進歩的な取り組みと言えます。

3.2. 生成AIの可能性

一方で生成AIは、「生成する」ことに留まらず、自然言語解析において非常に優れた能力を示します。

例えば、誹謗中傷に該当しそうなレビューがあるとします。

- 「この作品は、期待はずれでした。二度と買いません。」

- 「この作品は、期待はずれでした。次回の購入は買わないと思います。」

- 「この作品は、期待はずれでした。是非、買ってみてくださいww」

従来のAI(LLM登場以前[8])では、「期待はずれ」や「買わない」といった否定的な表現に引っ張られ、これら3つの全てをNGレビューとして扱う傾向にありました。

ただ、1番目のレビューは明確に否定的で不適なレビューに該当する可能性がありますが、2番目のレビューのトーンはやや柔らかく、将来の購入の可能性を完全には否定していないことから、適正な感想と言えます。

加えて3番目のレビューは人間なら皮肉であることを理解できるような内容です。しかし、従来のAIではこれらを理解するのが非常に難しかったのです。

生成AIの登場により、これらの皮肉や比喩、言外の意味までも簡易に理解するようになり、人の判断に近い状態を実現できるようになりました。

4. システム構成

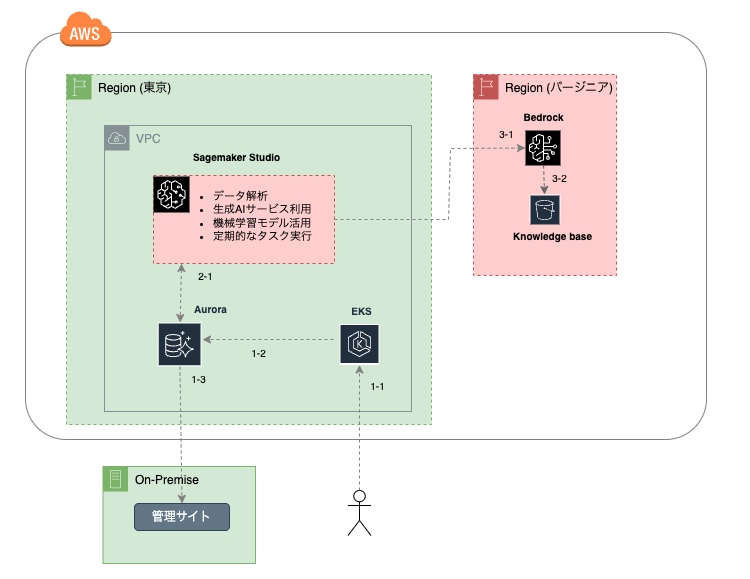

レビュー基盤がAWSにあったため、連携のしやすさからAWSのBedrockを利用しています。

既存システム(緑)に追加する形で新規サービス(赤)を立ち上げています。

(*注)ただしこれは分析と精度向上を主目的としているため暫定対応であり、今後の機能拡張や安定的な基盤運営に向けては改善予定です。

| 既存システム(緑) |

• レビュー投稿時、EKS[12]上のAPIを通じてデータ送信(1-1) • データはAuroraに保存(1-2) • 管理サイトでAuroraを使用し、レビューを承認(1-3) |

|---|---|

| 新規サービス(赤) |

• SageMakerStudio[13]を用いた分析とAI処理(2-1) - Notebookを使用したデータ解析 - 生成AIサービスの利用 - 機械学習モデルの活用 - 定期的なタスクの実行 • Amazon Bedrockサービスの活用 - 最新AIモデル使用のためバージニアリージョン利用(3-1) - Knowledge Baseを使用し、RAGを実現(3-2) |

5. 生成AIのモデル構築

AIのモデル構築にあたりいくつかの課題に直面し、それらを解決してきました。

5-1. プロンプトの改善

下記三点を対応し、AIに適切で明快な指示を与えるようにしました。

| 1. 事前知識の洗い替え |

• 対象となるレビューは一般的な倫理基準とは異なる特殊性がある • 通常のAIは「過激」「暴力的」「下品」に該当する可能性が高い • そこでAIの事前知識をアライメント[3]、特有コンテキストを理解させる |

|---|---|

| 2. 判断基準の明確化 |

• 10種類以上の詳細なNG基準(N001〜N01x)を設定 • OK/NGのサンプルを豊富に用意し、曖昧さを排除 • COT[10]の概念を導入し、段階的な判断プロセスを設定 |

| 3. トークン削減 |

• 当初のメガプロンプトは25,000トークン[11]以上(原稿用紙約70枚) • 長すぎるプロンプトはAIの理解を妨げ、ハルシネーションのリスクあり[4] • RAG[9]を活用し、9,000トークンまでトークン削減を実施 |

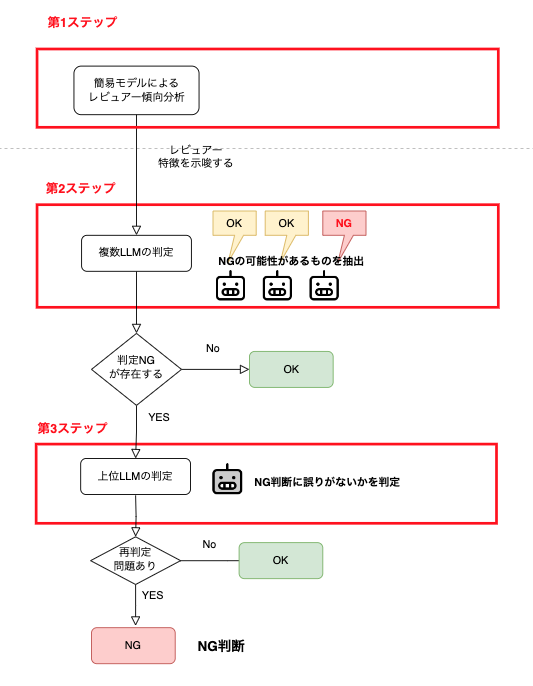

5-2. ステップ別のモデル構築

健康診断のスクリーニング検査[5]をヒントに、AIモデルの判定を複数ステップに分割し、段階的に精度を高めました。

低コストモデルは複雑な判断に不向きで、上位モデルはコストが膨大になる課題がありました。

そこで段階的アプローチにより、1日あたりの処理コストを約10ドルに抑えつつ、高い正解率[6]を達成。これによりコストと精度のバランスを最適化しました。

ステップ詳細

| 第1ステップ |

• 従来の機械学習の簡易モデルを使用 • レビュー及びレビュアーの特徴を分析 • 分析結果を第2ステップに渡す |

|---|---|

| 第2ステップ |

• Claudeの低コストのモデルを複数使用 • 様々な観点からレビュー内容を分析 • 1つのモデルでもNGに該当すれば第3ステップへ |

| 第3ステップ |

• Claudeの高度なモデルを使用 • 第1,2ステップの結果と理由を考慮 • レビュー内容をリライトし最終判定へ |

6. プロダクトへの実装

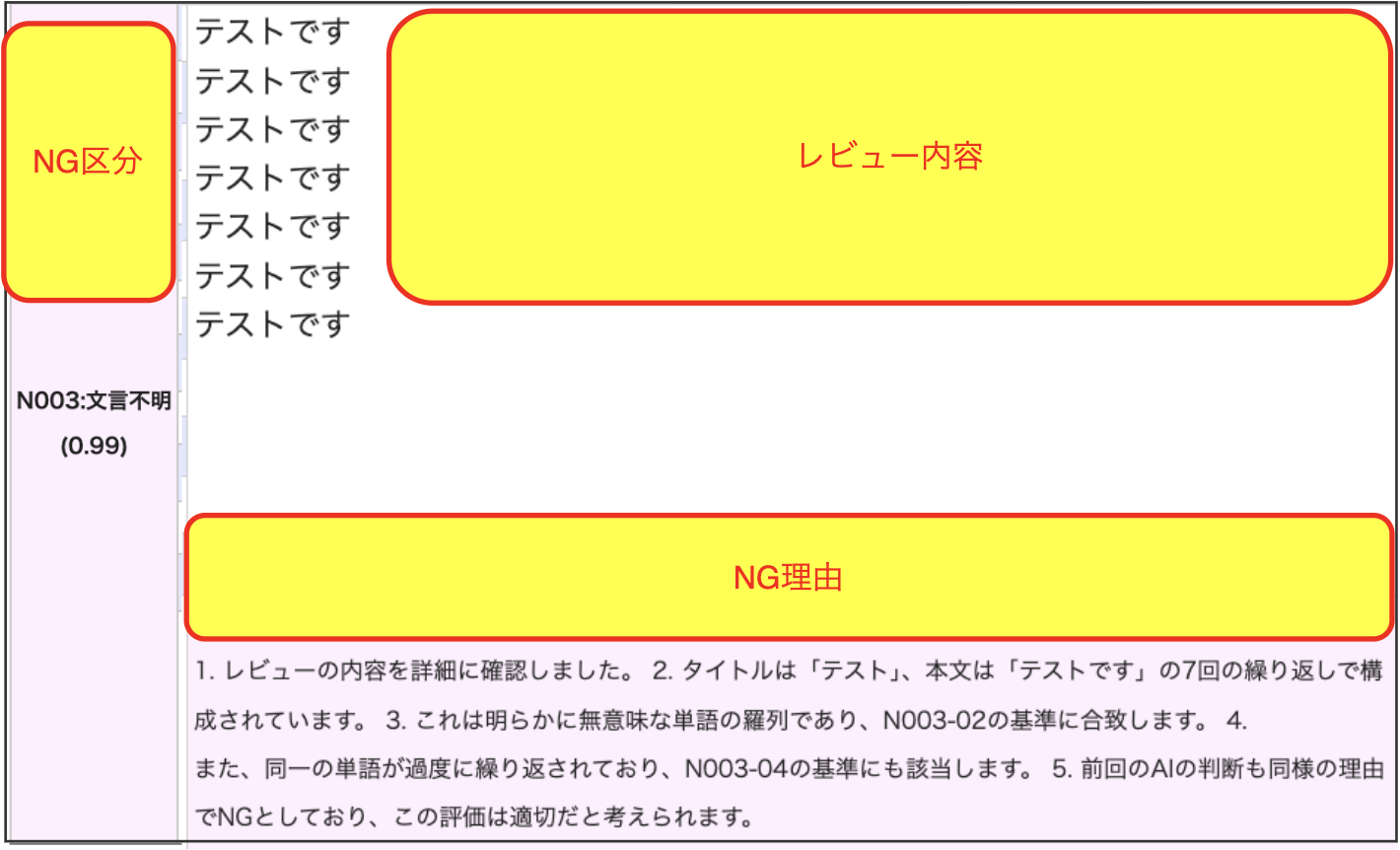

開発したAIモデルを既存の管理画面に統合し、人の判断を補助として実装しました。

不適切なレビューを検出した場合、レビュー掲載の審査プロセスにおいてNG区分やNG理由の情報が表示されます。

また「生成する」というAIの特徴を活かし、不適切と判断した理由については明確で具体的な根拠を提示します。

これにより審査担当者は迅速かつ正確な判断を下すことが可能となるのです。

7. 自動化に向けた課題

しかしながら人の判断の完全な代替えとして使用するには以下のような事象も考えなければいけません。

| 人の判断のばらつき |

• 同一レビューに対して、運営者間で判断が分かれるケースあり • 個人の経験や解釈の違いが原因 |

|---|---|

| 自然言語の曖昧さ |

• 「適切」「不適切」の明確な線引きが困難 • 公開ルールの決定が非常に難しい |

| AIの判断誤り |

• 99%の正解率でも1%の誤判断が存在 • 誤りがサイト運営上の重大な問題を引き起こす可能性あり |

8. 今後の対応

課題を踏まえ、現時点で考えている対策として以下を対応予定です。

| 危険度分類 |

• NGレビューをAIが誤って公開するケースが最大の問題 • レビュー内容の危険度を高、中、低に分類 • 危険度に応じた適切な対策を決定 |

|---|---|

| 段階的自動化 |

• 自動運転の5段階レベル分けを参考に段階的対応 • 現状:AIの判断を管理画面で表示(自動運転Lv1相当) • 今後:各段階ごとに自動化レベルを向上 |

| リスク管理の強化 |

• 導入初期:定期的な人手によるサンプルチェック • 継続的モニタリングの仕組みを構築 • AIが判断に迷うケース:人の判断によるエスカレーションプロセスを導入 |

9. まとめ

生成AIを活用したレビュー承認の自動化は、効率性と品質向上の両面で大きな可能性を秘めています。

依然として課題は存在するものの、段階的なアプローチと継続的な改善により、レビューの自動承認も可能と思われます。

この取り組みにより以下の効果も期待できます。

- 承認の即時化によるユーザー満足度の大幅な向上[7]

- 運営の作業コスト削減

- 一貫性のある判断基準の適用

- 社員の創造的な業務への注力

今後、我々のチームでは承認自動化のフェーズを進め、かつDMMのサービス品質向上に貢献していきます。

著者プロフィール:松井 高宏 DMM.comプラットフォーム開発本部のエンジニア。ユーザーレビューグループのチームリーダー兼テックリードとして、月間数十万件の投稿を処理するレビュープラットフォームの開発・運用を実施。8年以上の経験を活かし、最新技術を駆使しDMMの顧客体験向上に貢献している。

補足

* [1] 工数:現在2~3人で承認作業を行っており毎月1.5人月分の作業があります。

* [3] アライメント:AIの動作を特定の目的に合わせて調整すること。

* [4] ハルシネーション: AIが存在しない情報を生成する現象。

* [5] スクリーニング検査:初期段階で多数の対象から問題のある可能性が高いものを抽出する手法。

* [6] 再現率、適合率の観点からも精度改善が必要。

* [7] 現状、承認判断に数日かかることがあります。

* [8] LLM: 大規模言語モデル。ChatGPTなどが該当。

* [9] RAG: AIが外部知識を利用して回答を生成する技術。

* [10] COT: AIに段階的な思考プロセスを示させる手法。

* [11] トークン: 自然言語処理におけるテキストの最小単位。

* [12] EKS: AWSのマネージドKubernetesサービス。

* [13] SageMakerStudio: AWSの機械学習プラットフォーム。